03-2 선형 회귀(2) - 선형 회귀 알고리즘의 이해

03-2 선형 회귀(2) - 선형 회귀 알고리즘의 이해

k-최근접 이웃 회귀와 선형 회귀 알고리즘의 차이 이해

💡용어 정리💡

❓ 선형 회귀 ➡️ 대표적인 회귀 알고리즘, 비교적 간단하며 성능이 뛰어남!

–> 특성이 하나인 경우 어떤 직선을 학습하는 알고리즘

❓ 다항 회귀 ➡️ 다항식을 사용한 선형 회귀

1) 농어 데이터 선언 및 훈련/테스트 데이터로 분할, 특성 데이터의 2차원 배열 변환

import numpy as np

from sklearn.model_selection import train_test_split

import matplotlib.pyplot as plt

# 농어 데이터 선언

perch_length = np.array([8.4, 13.7, 15.0, 16.2, 17.4, 18.0, 18.7, 19.0, 19.6, 20.0, 21.0,

21.0, 21.0, 21.3, 22.0, 22.0, 22.0, 22.0, 22.0, 22.5, 22.5, 22.7,

23.0, 23.5, 24.0, 24.0, 24.6, 25.0, 25.6, 26.5, 27.3, 27.5, 27.5,

27.5, 28.0, 28.7, 30.0, 32.8, 34.5, 35.0, 36.5, 36.0, 37.0, 37.0,

39.0, 39.0, 39.0, 40.0, 40.0, 40.0, 40.0, 42.0, 43.0, 43.0, 43.5,

44.0])

perch_weight = np.array([5.9, 32.0, 40.0, 51.5, 70.0, 100.0, 78.0, 80.0, 85.0, 85.0, 110.0,

115.0, 125.0, 130.0, 120.0, 120.0, 130.0, 135.0, 110.0, 130.0,

150.0, 145.0, 150.0, 170.0, 225.0, 145.0, 188.0, 180.0, 197.0,

218.0, 300.0, 260.0, 265.0, 250.0, 250.0, 300.0, 320.0, 514.0,

556.0, 840.0, 685.0, 700.0, 700.0, 690.0, 900.0, 650.0, 820.0,

850.0, 900.0, 1015.0, 820.0, 1100.0, 1000.0, 1100.0, 1000.0,

1000.0])

# 훈련 데이터 테스트 데이터 분할

train_input, test_input, train_target, test_target = train_test_split(perch_length, perch_weight, random_state=42)

# 특성 데이터의 2차원 배열 변환

train_input = train_input.reshape(-1, 1)

test_input = test_input.reshape(-1, 1)

2) 모델 훈련 및 50농어 무게 예측

# 사이킷런의 선형 회귀 알고리즘

from sklearn.linear_model import LinearRegression

lr = LinearRegression()

# 모델 훈련

lr.fit(train_input, train_target)

# 특성 데이터를 이용하여 예측해야 하므로! 2차원 배열

print(lr.predict([[50]]))

실행결과)

[1241.83860323]

모델 피라미터(기울기와 절편) 구하기

- y = ax + b –> 농어 무게 = a * 농어 길이 + b

- 기울기 –> coef_

- b –> intercept_

print(lr.coef_, lr.intercept_)

실행결과)

[39.01714496] -709.0186449535477

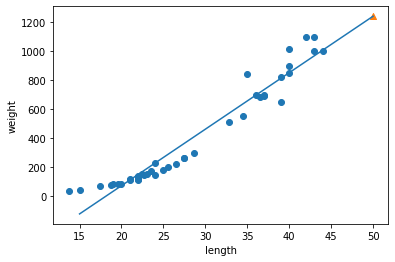

3) 1차 방정식을 이용한 선형 회귀 알고리즘

- 오류!! 직선 그래프의 왼쪽 끝 부분 농어의 무게는 수치상 음수임

plt.scatter(train_input, train_target)

# 15에서 50까지 1차 방정식 그래프 생성

plt.plot([15, 50], [15*lr.coef_+lr.intercept_, 50*lr.coef_+lr.intercept_])

# 50농어 데이터

plt.scatter(50, 1241.0, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

실행결과)

훈련 세트 테스트 세트에 대한 R^2 점수 확인

# 훈련 세트, 테스트 세트 score()

print(lr.score(train_input, train_target))

print(lr.score(test_input, test_target))

실행결과)

0.939846333997604

0.8247503123313558

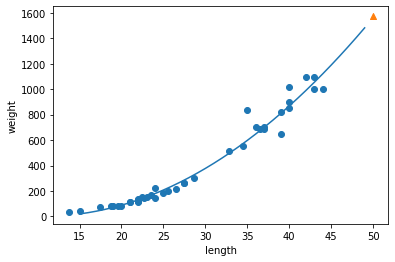

4) 2차 방정식을 이용한 선형 회귀 알고리즘

- 무게 = a * 길이^2 + b * 길이 + c

- 위 2차 방정식 계산을 위해서 길이 제곱 데이터 필요!

–> np.column_stack()을 이용해서 원래 데이터에 길이 제곱 데이터 추가

# 테스트 세트와 훈련세트의 특성 데이터 첫 열에 제곱 데이터 포함! --> 이차 방정식 그래프 그리기 위해서

train_poly = np.column_stack((train_input ** 2, train_input))

test_poly = np.column_stack((test_input ** 2, test_input))

print(train_poly.shape, test_poly.shape)

실행결과)

(42, 2) (14, 2)

새로 만든 배열을 이용하여 선형 회귀 모델 재훈련

- 특성 세트에는 제곱항을 추가했지만, 타깃 세트는 그대로 사용!

# 훈련을 덮어씌우기 할 때 마다 객체를 새로 생성하야 하나요? 같은 이름으로 생성하면 전에 훈련했던 데이터는 없어지나요?

lr = LinearRegression()

# 새로 만든 배열을 이용해 모델 재훈련

lr.fit(train_poly, train_target)

# 50cm 농어의 무게를 알기 위해, 50^2 값과 함께 넣어줌!

print(lr.predict([[50**2, 50]])) # 앞서 훈련한 모델보다 더 높은 값 예측

실행결과)

[1573.98423528]

무게 = 1.01 X 길이^2 - 21.6 X 길이 + 116.05

print(lr.coef_, lr.intercept_)

실행결과)

[ 1.01433211 -21.55792498] 116.0502107827827

1씩 짧게 끊어서 생성한 2차 방정식을 품은 산점도

# 구간별 그래프를 그리기 위해 15에서 49까지의 정수 배열 생성

point = np.arange(15, 50)

plt.scatter(train_input, train_target)

# 범위는 point로 설정하고, 2차 방정식 그래프를 그림

plt.plot(point, 1.01*point**2 - 21.6*point + 116.05)

# 50농어 데이터

plt.scatter(50, 1574, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

실행결과)

5) 훈련 세트와 테스트 세트의 R^2 점수 확인

# train R^2 < test R^2 --> 과소적합

print(lr.score(train_poly, train_target))

print(lr.score(test_poly, test_target))

실행결과)

0.9706807451768623

0.9775935108325122

댓글남기기